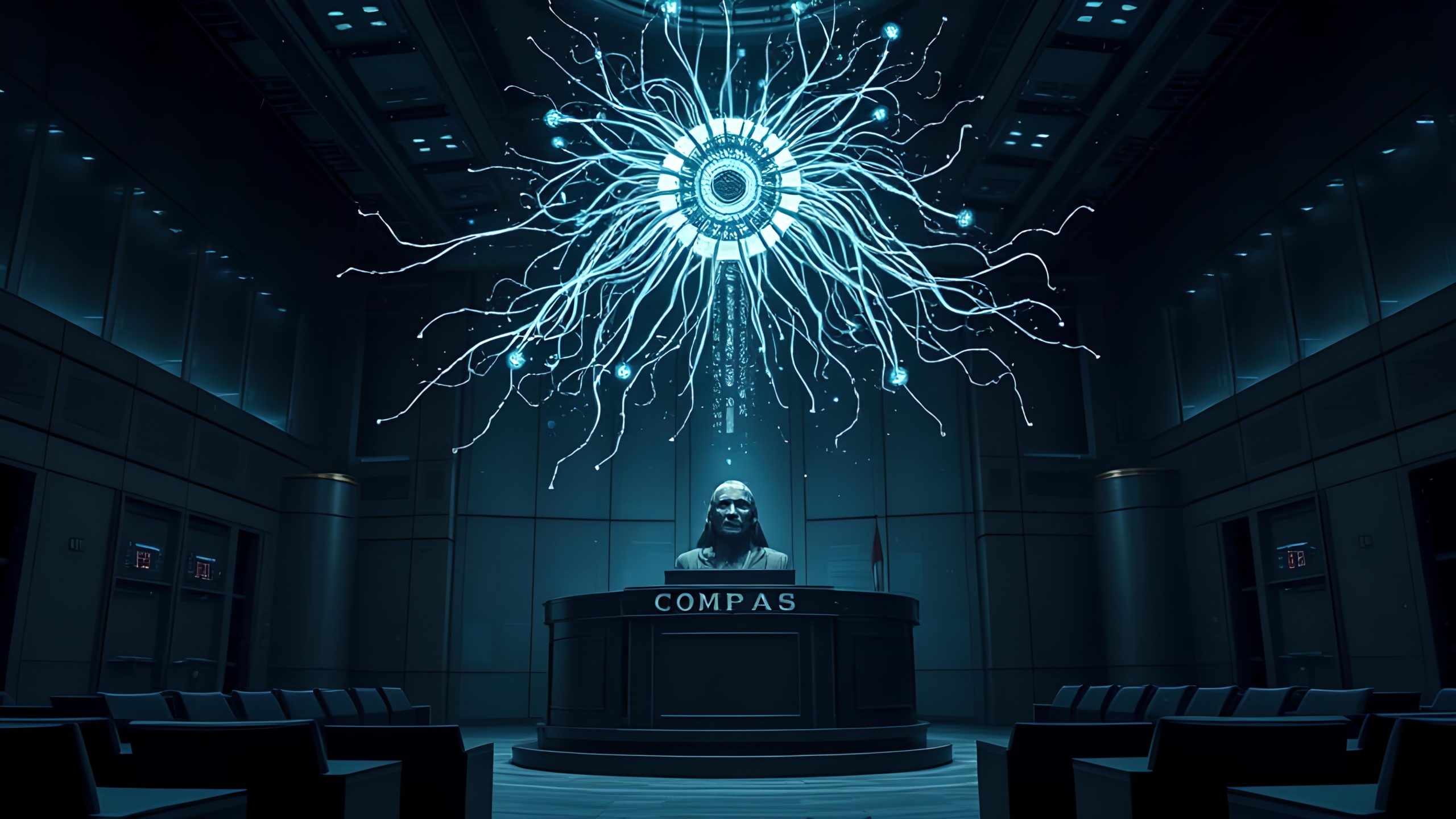

Algoritma dan Ketidakadilan Sosial: Kasus COMPAS dalam Sistem Peradilan Pidana di Amerika Serikat

Penggunaan kecerdasan buatan (AI) dalam sistem peradilan pidana diharapkan dapat meningkatkan efisiensi dan objektivitas dalam penanganan kasus-kasus kriminal. Namun, kenyataannya, algoritma yang digunakan dalam sistem ini justru sering kali memperparah ketidakadilan sosial, terutama bagi kelompok minoritas. Salah satu contoh paling kontroversial adalah algoritma COMPAS (Correctional Offender Management Profiling for Alternative Sanctions), yang digunakan secara luas di Amerika Serikat untuk menilai risiko residivisme (pengulangan tindak pidana) dan membantu hakim dalam menentukan hukuman. Sayangnya, algoritma ini telah terbukti memberikan hasil yang bias, terutama terhadap kelompok minoritas, terutama warga kulit hitam. Hal ini memunculkan pertanyaan serius tentang keadilan dalam penerapan teknologi AI dalam sistem hukum.

1. Bagaimana Algoritma COMPAS Bekerja

COMPAS adalah algoritma yang dirancang untuk memberikan skor risiko terhadap narapidana berdasarkan sejumlah faktor, termasuk usia, jenis kelamin, riwayat kriminal, dan faktor-faktor sosial lainnya. Skor ini digunakan oleh hakim untuk mempertimbangkan apakah seseorang harus diberikan hukuman lebih ringan, masa percobaan, atau penahanan lebih lama. Dalam konteks ini, COMPAS seharusnya menjadi alat yang obyektif untuk membantu mengurangi risiko subjektivitas manusia dalam pembuatan keputusan hukum.

Namun, algoritma ini mengandalkan data historis yang merefleksikan ketidakadilan sosial yang sudah ada dalam sistem peradilan pidana. Misalnya, komunitas kulit hitam dan minoritas lainnya di Amerika Serikat secara historis menghadapi diskriminasi dalam penegakan hukum, sehingga data yang dikumpulkan mengenai mereka lebih cenderung menunjukkan interaksi yang lebih tinggi dengan sistem peradilan, terlepas dari tingkat keseriusan pelanggaran yang sebenarnya. Ini menciptakan umpan balik bias dalam algoritma COMPAS, di mana minoritas rasial dipandang lebih berisiko melakukan pelanggaran di masa depan dibandingkan dengan individu kulit putih, bahkan jika mereka memiliki rekam jejak yang serupa.

2. Studi Tentang Bias dalam COMPAS

Pada tahun 2016, investigasi yang dilakukan oleh ProPublica mengungkap bahwa COMPAS secara signifikan lebih mungkin untuk memberikan skor risiko tinggi kepada terdakwa kulit hitam daripada terdakwa kulit putih. Melaui Jurnalisme Investigasi yang dilakukan oleh ProPublica tersebut, ditemukan bahwa dari kasus-kasus yang dianalisis, terdakwa kulit hitam yang tidak melakukan pelanggaran kembali lebih sering diberi prediksi risiko tinggi oleh COMPAS dibandingkan terdakwa kulit putih. Di sisi lain, terdakwa kulit putih yang sebenarnya melakukan pelanggaran kembali sering diberi skor risiko rendah, menunjukkan bias yang serius dalam cara algoritma ini bekerja.

ProPublica menemukan bahwa di antara terdakwa yang tidak kembali melakukan tindak pidana, 45% orang kulit hitam secara salah diberi label berisiko tinggi, dibandingkan dengan 23% orang kulit putih. Ini menunjukkan bahwa COMPAS secara tidak adil mendiskriminasi terdakwa kulit hitam, meningkatkan kemungkinan mereka untuk menerima hukuman yang lebih berat atau penahanan yang lebih lama daripada yang seharusnya. Hasil ini menjadi cerminan ketidakadilan sistemik yang telah lama ada dalam sistem peradilan pidana Amerika Serikat.

3. Dampak Sosial dari Bias Algoritma

Bias dalam algoritma seperti COMPAS memiliki dampak sosial yang sangat besar. Ketika keputusan penting tentang kehidupan seseorang—seperti apakah mereka akan dipenjara atau diberikan hukuman lebih ringan—dibuat berdasarkan algoritma yang bias, hal ini memperparah ketidakadilan yang sudah ada dalam masyarakat. Orang-orang dari kelompok minoritas, khususnya komunitas kulit hitam, sudah lebih mungkin untuk menghadapi penangkapan dan hukuman yang tidak proporsional dibandingkan dengan orang kulit putih. Dengan menggunakan algoritma yang memperkuat bias ini, sistem hukum secara tidak langsung mendukung ketidaksetaraan yang ada, memperburuk masalah yang seharusnya dipecahkan.

Selain itu, dampak sosial dari bias algoritma ini tidak hanya terbatas pada individu yang terlibat langsung dalam sistem peradilan. Keputusan berbasis AI yang bias dapat memperburuk segregasi sosial, memperdalam ketidakpercayaan antara komunitas minoritas dan lembaga hukum, serta meningkatkan ketidaksetaraan ekonomi yang sudah ada. Sistem peradilan yang diharapkan menjadi pilar keadilan bagi semua warga negara justru menjadi alat untuk mempertahankan ketidakadilan.

4. Masalah Transparansi dan Akuntabilitas Algoritma

Salah satu masalah mendasar dalam penggunaan AI di sistem peradilan adalah kurangnya transparansi. Algoritma seperti COMPAS merupakan sistem berpemilik (proprietary), yang berarti bahwa rincian lengkap tentang bagaimana skor risiko dihitung tidak tersedia untuk publik maupun terdakwa yang terkena dampaknya. Hakim, pengacara, dan terdakwa sendiri sering kali tidak memahami faktor-faktor apa yang dipertimbangkan oleh algoritma dan bagaimana bobot diberikan pada masing-masing faktor. Ini menciptakan situasi di mana keputusan yang sangat penting, seperti lamanya penahanan atau pemberian pembebasan bersyarat, dapat dipengaruhi oleh proses yang tidak dapat diuji atau diperdebatkan secara terbuka.

Kurangnya transparansi ini menciptakan masalah akuntabilitas. Jika suatu algoritma salah menilai risiko seseorang, atau jika bias sistemik dimasukkan ke dalam algoritma, siapa yang bertanggung jawab? Saat ini, tidak ada mekanisme yang jelas untuk menantang hasil algoritma dalam banyak kasus, sehingga individu yang dirugikan oleh kesalahan algoritma sering kali tidak memiliki jalan hukum yang memadai untuk menuntut keadilan.

5. Menuju Pengaturan dan Reformasi yang Lebih Baik

Untuk mengatasi masalah ini, penting untuk mengambil langkah-langkah reformasi yang signifikan dalam penerapan AI dalam sistem peradilan pidana. Beberapa solusi yang diusulkan antara lain:

- Transparansi dan Audit Algoritma: Algoritma yang digunakan untuk membuat keputusan yang mempengaruhi kehidupan seseorang harus diaudit secara berkala oleh pihak independen untuk memastikan bahwa mereka tidak bias dan bekerja sesuai dengan standar keadilan. Rincian tentang cara kerja algoritma juga harus tersedia untuk publik dan para terdakwa, sehingga mereka dapat memahami bagaimana keputusan dibuat.

- Regulasi yang Lebih Ketat: Pemerintah harus mengembangkan regulasi yang lebih ketat untuk mengatur penggunaan AI dalam sistem peradilan. Ini termasuk menetapkan standar untuk mengidentifikasi dan mengatasi bias dalam algoritma serta menetapkan mekanisme akuntabilitas jika algoritma memberikan hasil yang tidak adil.

- Pendidikan dan Pelatihan: Hakim, pengacara, dan pejabat peradilan lainnya perlu dilatih dalam memahami bagaimana algoritma bekerja dan bagaimana mereka dapat mempengaruhi keputusan hukum. Dengan pemahaman yang lebih baik, para profesional hukum dapat lebih waspada terhadap potensi bias dan lebih mampu menantang hasil algoritma yang merugikan.

Penutup

Kasus COMPAS menunjukkan bahwa penggunaan AI dalam sistem peradilan pidana dapat memperburuk ketidakadilan sosial jika tidak diatur dan diawasi dengan baik. Algoritma yang seharusnya netral dapat mewarisi bias sistemik dari data yang mereka analisis, menciptakan hasil yang diskriminatif terhadap kelompok minoritas. Tanpa transparansi dan akuntabilitas yang memadai, AI dapat menjadi alat yang memperkuat ketidakadilan alih-alih menguranginya. Oleh karena itu, penting bagi pembuat kebijakan dan masyarakat luas untuk menuntut reformasi dalam penggunaan AI di sistem peradilan agar keadilan yang sesungguhnya dapat tercapai.

Referensi

- Angwin, Julia, et al. “Machine Bias: There’s Software Used Across the Country to Predict Future Criminals. And It’s Biased Against Blacks.” ProPublica, May 23, 2016.

- Chouldechova, Alexandra. “Fair Prediction with Disparate Impact: A Study of Bias in Recidivism Prediction Instruments.” Big Data, vol. 5, no. 2, 2017, pp. 153-163.

- Eubanks, Virginia. Automating Inequality: How High-Tech Tools Profile, Police, and Punish the Poor. St. Martin’s Press, 2018.

- Richardson, Rashida, Jason Schultz, and Kate Crawford. “Dirty Data, Bad Predictions: How Civil Rights Violations Impact Police Data, Predictive Policing Systems, and Justice.” NYU Law Review, vol. 94, 2019.

AI: ChatGPT

Post Comment